Die Entwicklungen im Bereich der künstlichen Intelligenz (KI) vollziehen sich im Eiltempo. Doch der Einsatz der KI-Technologien wirft viele Fragen auf. Mit dem Artificial Intelligence Act (AI Act), dem KI-Gesetz, will die Europäische Union Regeln und einen gesetzlichen Rahmen für den Einsatz von KI schaffen. Wie die KI reglementiert werden soll und KI-Anwendungen durch den Einsatz synthetischer Daten sicherer und vertrauensvoller gestaltet werden sollen.

- Künstliche Intelligenz (KI) und wie sie eingesetzt wird

- EU AI Act: Das steckt hinter dem KI-Gesetz

- Chancen und Risiken durch den Einsatz von KI

- Was soll mit dem AI Act verboten werden?

- Regulierung der KI-Anwendungen

- Sicherer Einsatz von KI durch synthetische Daten

- EU AI Act und synthetische Daten

- Strafrahmen und Wirksamkeit des AI Acts

- Take Aways

Künstliche Intelligenz (KI) und wie sie eingesetzt wird

Über viele Jahre galt künstliche Intelligenz (KI) als eine zukunftsweisende Technologie, der ein enormes Potenzial zugeschrieben wurde. Von vielen Seiten unbemerkt haben sich KI-Anwendungen in den letzten Jahren allerdings immer weiter in den Alltag eingeschlichen. Viele KI-Technologien (englisch: Artificial Intelligence, AI) sind mittlerweile weit verbreitet und werden kaum noch als solche wahrgenommen. Spätestens mit der aufsehenerregenden Entwicklung rund um ChatGPT im Jahr 2023 ist das Bewusstsein rund um künstliche Intelligenz jedoch auch in der breiten Bevölkerung angekommen.

Was ist künstliche Intelligenz?

Unter künstlicher Intelligenz versteht man allgemein die Fähigkeit von Maschinen, Computern und Software, menschliche Eigenschaften wie logisches Denken, Lernen, Planen und Kreativität zu imitieren.

Gestützt wird KI von technischen Entwicklungen, die es den Systemen ermöglichen, die Umwelt wahrzunehmen. Dazu gehören Sensoren, Mikrofone, Kameras, Bewegungsmelder sowie komplexe Trainings-Algorithmen, das Erkennen verschiedenster Ereignisse ermöglichen. Auf Basis der Trainingsdaten und den neu gewonnenen Echtzeit-Daten kann eine gut programmierte KI ohne weiteres menschliches Zutun selbstständig Prozesse steuern Entscheidungen treffen und Handlungen ausführen.

KI-Systeme sind dabei in der Regel lernende Systeme. Sie können daher nicht nur reaktiv agieren, sondern auch auf Basis bestimmter Parameter, früherer Aktionen oder Ereignisse autonom arbeiten und auch proaktiv und präventiv in Prozesse eingreifen. Eine Tatsache, die sie besonders auch für die Wirtschaft und industrielle Zwecke wertvoll macht.

Einsatz von künstlicher Intelligenz im Alltag

An ChatGPT, der von dem Unternehmen Open AI entwickelten KI-Anwendung, die automatisch Texte generiert, ist im Jahr 2023 kaum jemand vorbeigekommen. Weitere softwaregestützte KI-Lösungen wie der Bildgenerator DALL-E oder das auf das Verfassen von für Internet-Suchmaschinen optimierten Texten konzipierte SEO (Search-Engine-Optimization) Tool Jasper haben breitere Anwendung gefunden.

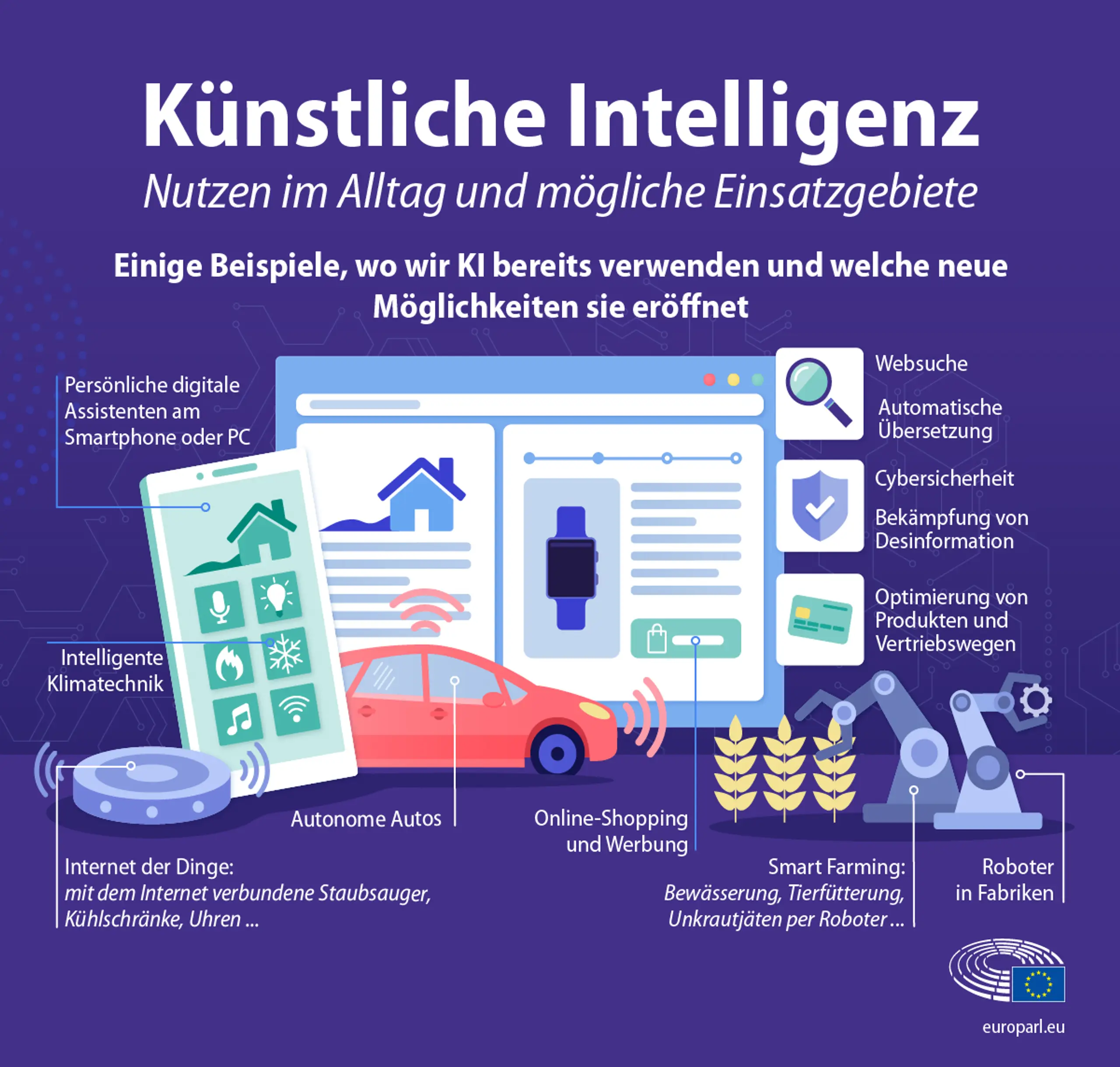

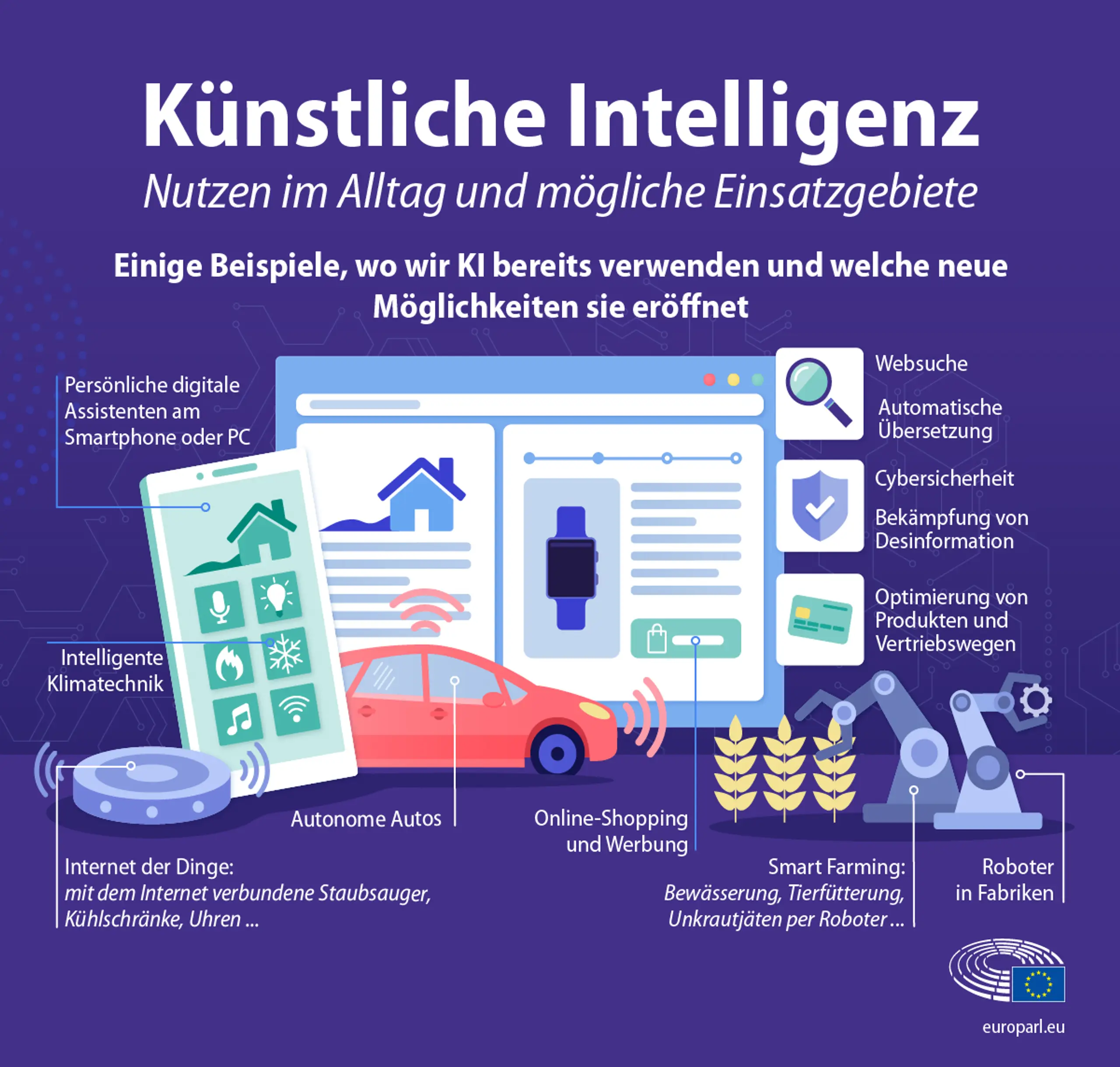

Daneben gibt es jedoch eine Fülle weiterer KI-Lösungen, die im Lauf der letzten Jahre schleichend den Weg in den Alltag gefunden werden und beinahe schon wie selbstverständlich genutzt werden, ohne dass man sie als künstliche Intelligenz oder AI-Anwendung wahrnehmen würde. Zu diesen Lösungen gehören etwa die Sprachsteuerung oder persönliche digitale Assistenten am Smartphone oder Computer, die intelligente Gerätesteuerung im Bereich der Haustechnik, die Ergebnisse der Internet-Suchmaschinen, Kauf-Vorschläge bei Online-Shopping-Websites, Empfehlungen von Streaming-Websites, die Steuerung von Industrierobotern in Fabriken, Lösungen im Bereich der Landwirtschaft (Stichwort Smart Farming) oder die Entwicklungen im Bereich der der selbstfahrenden Autos und der Roboter-Taxis (siehe Grafik).

KI-Einsatz im Alltag

© europarl.euEinen umfassenden Überblick zum aktuellen Stand der KI-Technologien und ihren vielfältigen Anwendungen finden Sie in unserem Thema "Künstliche Intelligenz (KI)"

EU AI Act: Das steckt hinter dem KI-Gesetz

Mit dem Artificial Intelligence Act, auch als AI Act oder KI-Gesetz bezeichnet, versucht die Europäische Union nun den Einsatz der KI-Technologien in geordnete Bahnen zu lenken und einen gesetzlichen Rahmen für den Einsatz dieser Lösungen zu schaffen. Die EU ist damit in einer internationalen Vorreiterrolle, denn der EU AI Act ist weltweit das erste umfassende KI-Gesetz und soll nach der Verabschiedung einen integralen Bestandteil der umfassenden digitalen Strategie der Europäischen Union darstellen.

Der Rechtsrahmen sieht unter anderem vor, dass KI-Systeme unterschiedlichen Risiko-Stufen zugeteilt werden, die je nach Risiko-Faktor einer bestimmten Regulierung unterworfen sind. Für diese Einstufung ist jedoch nicht die KI-Lösung alleine entscheidend. In die Bewertung und die folgende Regulierung wird auch mit einbezogen, in welchem Feld die jeweilige Anwendung zum Einsatz kommt.

Digitalisierungs-Staatssekretär Florian Tursky: "KI-Anwendungen müssen auch Transparenzverpflichtungen wahrnehmen."

© beigestelltDie Vorschriften sollen dafür sorgen, dass in der EU entwickelte und eingesetzte KI in vollem Umfang den Rechten und Werten der EU entspricht, von Menschen beaufsichtigt wird, Anforderungen an Sicherheit, Datenschutz und Transparenz genügt, niemanden diskriminiert und weder Gesellschaft noch Umwelt schädigt. In Zukunft sollen bestimmte Pflichten für Anbieterinnen und Anbieter sowie Nutzerinnen und Nutzer von KI gelten und KI-Systeme, die die menschliche Sicherheit oder Persönlichkeitsrechte gefährden, verboten werden. Dazu gehört unter anderem das sogenannte "Social Scoring" – die Klassifizierung von Personen auf der Grundlage ihres sozialen Verhaltens oder ihrer Persönlichkeitsmerkmale.

Am 14. Juni 2023 hat das Europäische Parlament die Position zum KI-Gesetz angenommen. In der Folge sind die Vertreter der EU-Mitgliedstaaten an der Reihe. Sie müssen die endgültige Form des AI Acts verhandeln.

Für Österreich wird der für Digitalisierung zuständige Staatssekretär Florian Tursky im Verhandlungsteam sein. Er erklärte dazu: "Wichtig ist für Europa, rasch zu einer klugen KI-Regulierung zu kommen, die Innovation ermöglicht, aber gleichzeitig Massenüberwachung oder 'Social Scoring' mittels KI-Anwendungen untersagt. KI-Anwendungen müssen auch Transparenzverpflichtungen wahrnehmen, damit für die Konsumentinnen und Konsumenten zu jeder Zeit klar ersichtlich ist, wenn sie mit einer künstlichen Intelligenz konfrontiert sind und woher die Informationen stammen."

Chancen und Risiken durch den Einsatz von KI

Grundsätzlich stehen die Europäische Union und ihre Mitgliedsstaaten dem Einsatz der KI-Technologien sehr aufgeschlossen gegenüber. Man ist sich bewusst, dass die KI-Anwendungen enorme Vorteile schaffen können. Das gilt sowohl für die Wirtschaft, Business-to-Business-Lösungen, im Bereich der Verwaltung, Behörden, Gesundheitsversorgung als auch für private Lebensbereiche. Allerdings könnten dadurch auch die Meinungsfreiheit, die Privatsphäre oder andere Persönlichkeitsrechte eingeschränkt werden. Dem will die EU mit dem AI Act einen Riegel vorschieben.

Im folgenden Überblick sind die wichtigsten Vorteile und gravierendsten Risiken aus der Sicht des Europäischen Parlaments angeführt:

Vorteile von KI

Für Bürger. KI kann die Gesundheitsversorgung zu verbessern, Autos und andere Verkehrsmittel sicherer machen und maßgeschneiderte, preiswertere und langlebigere Produkte und Dienstleistungen ermöglichen. Auch der Zugang zu Informationen sowie zu allgemeiner und beruflicher Bildung kann durch den Einsatz von KI erleichtert werden. KI kann zur Arbeitsplatzsicherheit beitragen, indem zum Beispiel Roboter für gefährliche Arbeitsschritte eingesetzt werden. Neue Jobs entstehen, da Branchen, die künstliche Intelligenz einsetzen, wachsen und sich weiterentwickeln.

Für Unternehmen. KI ermöglicht die Entwicklung neuer Produkte und Dienstleistungen und stärkt damit auch Sektoren, in denen europäische Unternehmen bereits eine starke Position haben: grüne Wirtschaft und Kreislaufwirtschaft, Maschinenbau, Landwirtschaft, Gesundheitswesen, Mode, Tourismus. KI kann zudem genutzt werden, um Vertriebswege zu optimieren, Wartungstechniken zu verbessern, die Produktionsleistung und -qualität zu steigern, den Kundenservice zu verbessern und Energie zu sparen.

Öffentlicher Dienst. KI-Lösungen können Kosten senken, neue Möglichkeiten in den Bereichen öffentlicher Verkehr, Bildung, Energie und Abfallwirtschaft eröffnen und die Nachhaltigkeit von Produkten erhöhen. Die KI-Technologien können zudem einen Beitrag leisten, um die Ziele des europäischen Green Deals zu erreichen.

Schutz der Demokratie. KI-Lösungen können gezielt zum Schutz vor Desinformation oder Cyberangriffen eingesetzt werden. Der Schutz vertrauenswürdiger Informationen und die Gewährleistung des Zugangs dazu kann die Demokratie stärken. Auch Chancengleichheit und Vielfalt könnten durch KI-Tools gefördert werden.

Sicherheit. KI kann zur Verbrechensprävention und die Strafverfolgung eingesetzt werden. Die Fluchtgefahr von Gefangenen kann genauer eingeschätzt und Straftaten oder sogar Terroranschläge vorhergesagt und verhindert werden. Auch Hass oder anderes unangemessenes Verhalten im Netz kann dadurch verfolgt und schließlich unterbunden werden. Im militärischen Bereich kann KI für Verteidigungs- und Angriffsstrategien bei Hacking und Phishing Anwendung finden.

Risiken der KI

Richtiger Einsatz. Wird das Potenzial der KI nicht ausreichend genutzt, kann das die Wettbewerbsfähigkeit beeinträchtigen und in der Folge eine wirtschaftliche Stagnation auslösen. Jedoch kann auch ein überbordender Einsatz von der KI-Lösungen problematisch sein, etwa aufgrund von Lösungen, die sich in der Folge als nicht nachhaltig erweisen.

Haftung im Schadensfall. Nicht eindeutig ausjudiziert ist die Haftung für Schäden, die etwa durch KI-gesteuerte Geräte oder Dienste verursacht werden. Die EU steht auf dem Standpunkt, dass auch der Hersteller in die Verantwortung genommen werden sollte, sucht aber einen Weg, um Innovationen nicht durch eine zu strenge Regulierung abzuwürgen.

Gefahren für Grundrechte und Demokratie. Ein Problem in diesem Zusammenhang stellt das sogenannte "Mathwashing" dar, eine gezielte Fehlinformation durch das Herauslösung von bestimmter Daten und Fakten, die Informationen verzerren und nur scheinbar korrekte Informationen darstellen. Ein falscher Einsatz von KI kann zudem zur Benachteiligung von Personen oder Personengruppen führen, etwa wenn in Entscheidungen die ethnische Zugehörigkeit, das Alter oder das Geschlecht einbezogen werden. Weitere Risikofaktoren stecken in der automatisierten Personen- und Gesichtserkennung, im Tracking und Profiling

Deepfakes. KI kann dazu missbraucht werden, extrem realistische gefälschte Videos, Audioaufnahmen und Bilder, sogenannte "Deepfakes" zu erzeugen. Das kann dazu ausgenutzt werden, um Personen zu diskreditieren, falsche Meinungen zu verbreiten, zu polarisieren oder Wahlen zu manipulieren.

Arbeitsplätze. KI kann in bestimmten Sektoren Arbeitsplätze schaffen. Sie kann aber ebenso genutzt werden, um Arbeitskräfte einzusparen und somit Arbeitsplätze vernichten. Bildung und Weiterbildung gewinnen durch einen verbreiteten KI-Einsatz weiter an Bedeutung, um sich Arbeitsmarkt behaupten zu können.

Wettbewerb. Daten, Informationen und Algorithmen gewinnen durch KI weiter an Wert. Ein größerer Datenpool bedeutet einen Wettbewerbsvorteil.

Sicherheit. KI-Tools können missbraucht oder gehackt werden. Ein besonderes Risiko stellen in dem Zusammenhang KI-Implantate dar.

Transparenz. Für Menschen kann es unklar sein, ob sie mit einer KI oder einer echten Person interagieren. Zudem können Vorteile beim Informationszugang ausgenutzt werden oder das Online-Verhalten einzelner Personen von einer KI getrackt und missbräuchlich verwendet werden.

Was soll mit dem AI Act verboten werden?

Das Europäische Parlament will vor allem sicherstellen, dass die in der EU eingesetzten KI-Systeme sicher, transparent, nachvollziehbar, nicht diskriminierend und umweltfreundlich sind. KI-Systeme sollten von Menschen und nicht von der Automatisierung überwacht werden, um schädliche Ergebnisse zu verhindern.

Verboten werden sollen KI-Systeme, die als Bedrohung für die Menschen gelten und daher ein unannehmbares Risiko darstellen. Dazu gehören:

Kognitive Verhaltensmanipulation von Personen oder bestimmten gefährdeten Gruppen, zum Beispiel sprachgesteuertes Spielzeug, das gefährliches Verhalten bei Kindern fördert.

Soziales Scoring, die Klassifizierung von Menschen auf der Grundlage ihres Verhaltens, ihres sozioökonomischen Status oder persönlichen Merkmalen.

Biometrische Echtzeit-Fernidentifizierungssysteme, etwa die automatisierte Gesichtserkennung. Dabei können allerdings Ausnahmen zulässig sein. So sollen beispielsweise Systeme zur nachträglichen biometrischen Fernidentifizierung, bei denen die Identifizierung mit erheblicher Verzögerung erfolgt, zur Verfolgung schwerer Straftaten nach gerichtlicher Genehmigung zugelassen werden.

Regulierung der KI-Anwendungen

Weitere Bestimmungen im KI-Gesetz der EU sollen andere Anwendungen in geordnete Bahnen lenken.

Hochrisiko-KI-Systeme

Als Hochrisiko-Systeme gelten KI-Modelle, die ein hohes Risiko für die Gesundheit und Sicherheit oder für die Grundrechte natürlicher Personen darstellen. Alle KI-Systeme mit hohem Risiko werden vor dem Inverkehrbringen und während ihres gesamten Lebenszyklus bewertet. Sie werden in zwei Hauptkategorien eingeteilt.

KI-Systeme, die in Produkten verwendet werden, die unter die Produktsicherheitsvorschriften der EU fallen. Dazu gehören Spielzeug, Luftfahrt, Fahrzeuge, medizinische Geräte und Aufzüge.

KI-Systeme, die in einen der acht folgenden spezifischen Bereiche fallen und in einer EU-Datenbank registriert werden müssen:

Biometrische Identifizierung und Kategorisierung von natürlichen Personen

Verwaltung und Betrieb von kritischen Infrastrukturen

Allgemeine und berufliche Bildung

Beschäftigung, Verwaltung der Arbeitnehmer und Zugang zur Selbstständigkeit

Zugang zu und Inanspruchnahme von wesentlichen privaten und öffentlichen Diensten und Leistungen

Strafverfolgung

Verwaltung von Migration, Asyl und Grenzkontrollen

Unterstützung bei der Auslegung und Anwendung von Gesetzen

Generative KI

Als generative KI-Modelle oder GPAIS, General Purpose AI Systems, gelten Lösungen wie etwa das bekannte ChatGPT. Sie werden künftig an die Leine genommen und sollen laut EU-Plan einige Transparenz-Anforderungen erfüllen:

Eine Offenlegung, dass der Inhalt durch KI generiert wurde.

Die Erzeugung illegaler Inhalte verhindern

Zusammenfassungen der urheberrechtlich geschützten Daten veröffentlichen, die für das Training verwendet wurden.

Begrenztes Risiko

KI-Systeme mit begrenztem Risiko sollten minimale Transparenz-Anforderungen erfüllen, die es den Nutzern ermöglichen, fundierte Entscheidungen zu treffen. Nach der Interaktion mit den Anwendungen soll der Nutzer entscheiden können, ob er sie weiter verwenden möchte. Die Nutzer sollten darauf aufmerksam gemacht werden, wenn sie mit KI interagieren. Dies gilt auch für KI-Systeme, die Bild-, Audio- oder Videoinhalte erzeugen oder manipulieren (zum Beispiel Deepfakes).

Sicherer Einsatz von KI durch synthetische Daten

Ein Mittel, der einen zumindest hinsichtlich des Personenschutzes sicheren Einsatz von KI-Lösungen ermöglicht, sind synthetische Daten.

Unter synthetischen Daten versteht man Daten, die durch Simulationen oder Algorithmen generiert werden. Sie beruhen nicht auf echten Messungen oder Datenerhebungen, wobei zwischen vollständig synthetischen Daten und teilweise synthetischen Daten unterschieden wird, wobei sich letztere noch an Datenbanken bedienen und daraus neue Daten ohne jeglichen Personenbezug generieren. Bei vollständig synthetischen Daten handelt es sich um komplett neu geschaffene Informationen, die von einem Algorithmus generiert werden.

Zum Einsatz gekommen sind solche synthetischen Daten bisher etwa beim Trainieren von Maschinen in Zusammenhang mit Machine Learning bzw. Deep Learning. Synthetische Daten sind aber auch hinsichtlich der von der EU formulierten Ziele von nicht diskriminierenden und alle Menschen gleich behandelnden KI-Lösungen im Vorteil.

Werden nämlich KI-Anwendungen mit Echt-Daten trainiert, so besteht die Gefahr, dass die daraus folgenden KI-Anwendungen gesellschaftliche Ungleichheiten beinhalten, etwa die Bevorzugung von „weißen Männern“ bei Bewerbungen oder die Benachteiligung von Frauen bei Kreditvergaben.

EU AI Act und synthetische Daten

Das Wiener Start-up Mostly AI ist Vorreiter in der Erzeugung von KI-generierten synthetischen Daten. Tobias Hann, CEO des Unternehmens, sieht in dieser Form der Daten eine Lösung vieler Probleme. „Es ist das Gebot der Stunde, Künstliche Intelligenz vertrauenswürdig zu gestalten“, betont er: "Synthetische Daten sind dafür gemacht, um Daten zu anonymisieren und eine Re-Identifizierung auf den Urheber der Daten unmöglich zu machen. Damit unterliegen synthetische Daten auch nicht der DSGVO oder anderen Datenschutzrechtlinien."

Alexandra Ebert ist Chief Trust Officer (CTrO) bei Mostly AI. Als solche ist sie verantwortlich für die Zusammenarbeit mit Datenschutzexperten, Aufsichtsbehörden, Medien und Kunden und wirkt in internationalen Expertengruppen mit. Der Hauptteil ihrer Arbeit besteht darin, Gesetzgeber und regulatorische Institutionen zu beraten, worauf bei der Legislative rund um KI und KI-Ethik zu achten ist, um Prinzipien wie Datenschutz, Fairness und Erklärbarkeit zu erfüllen.

Alexandra Ebert, Expertin für synthetische Daten und Beraterin des EU Parlaments bei der Umsetzung des AI Acts, dem KI-Gesetz.

© Florian SchulteSeit dem Jahr 2021 hat Ebert das EU-Parlament bei der Umsetzung des AI Acts beraten, seit Mai 2023 ist sie zudem Mitglied der „Synthetic Data Experts Group“ der Finanzaufsichtsbehörde in London (FCA).

Ebert betont, dass durch die Verwendung synthetischer Daten historisch vorurteilsbehaftete Echtdaten ausgeglichen werden und mehr Diversität in den KI-Trainingsdatensätze entstehen kann. Werde etwa eine KI auf fairen synthetischen Daten trainiert, in denen kein Gender Pay Gap mehr existiert oder ausreichend Beispiele von Minderheiten enthalten sind, dann wirke sich das positiv auf die Fairness des KI-Modells aus und könne somit Diskriminierungen vorbeugen. Zudem würden synthetische Daten Verstöße gegen Datenschutz-Regularien ausschließen.

„Mich faszinierte schon früh, wie sich neue Technologie nicht nur auf die Wirtschaft, sondern auch auf die Gesellschaft auswirkten“, betont Ebert. „KI wird unser aller Leben signifikant verändern. Deshalb ist es für mich enorm sinnstiftend daran zu arbeiten, dass KI ethischer, fairer, datenschutzkonformer und erklärbarer wird.“ Das sieht man auch in Brüssel so. In einem Bericht des Joint Research Centre, der gemeinsamen Forschungsstelle der Europäischen Kommission, werden synthetische Daten als Treiber für die Verwendung von AI und kosteneffizientes, ausgereiftes Tool bewertet. Synthetische Daten stehen für Datenschutz, Fairness, Diversität und Inklusion und sind daher auch eine bedeutende Lösung bei der weiteren Ausgestaltung des KI-Gesetzes.

Strafrahmen und Wirksamkeit des AI Acts

Wenn wie geplant bis zum Jahresende eine Einigung im Trilog erzielt wird, kann der europäische AI Act beschlossen werden. Den Unternehmen bleibt anschließend eine Frist von etwa zwei Jahren, um sich an die neuen Rahmenbedingungen anzupassen. Damit die Lücke bis zur Wirksamkeit des Gesetzes nicht überbordend ausgenutzt wird, will die EU große Technologiekonzerne und maßgebliche KI-Entwickler bereits zuvor zu einer freiwilligen Selbstkontrolle verpflichten.

Für Verstöße gegen die Bestimmungen des AI Acts sind Strafen von bis zu 30 Millionen Euro oder sechs Prozent des weltweiten Gewinns vorgesehen – je nachdem, welcher Betrag höher ist.

Take Aways

Der AI Act der Europäischen Union, das KI-Gesetz, soll einen vertrauensvollen und transparenten Einsatz von KI-Lösungen bewirken.

Der Gesetzesbeschluss wurde Mitte Juni 2023 verabschiedet, die Detailbestimmungen werden nun ausgearbeitet.

Es handelt sich um den weltweit ersten Ansatz, einen juristischen und gesellschaftlichen Rahmen für den Einsatz von KI-Lösungen zu schaffen.

Synthetische Daten stellen einen vielversprechenden Ansatz zur Wahrung von Persönlichkeitsrechten im KI-Umfeld dar.