Das KI-Tool aus dem Hause Stability AI kann aus Textbeschreibungen Bilder generieren. Wie funktioniert der Text-Bild-Generator? Wem gehören die Bilder? Und welche Alternativen gibt es?

- Was ist Stable Diffusion?

- Welches Unternehmen steht hinter Stable Diffusion?

- Welche Technik steckt hinter Stable Diffusion?

- Rechtsstreit - Wem gehören die Trainingsdaten?

- Wie funktioniert Stable Diffusion?

- Was kostet Stable Diffusion?

- Alternativen zu Stable Diffusion

- Copyright - Wem gehört das Bild?

- Stable Diffusion: Vergleich zu DALL-E und Midjourney

- Fazit

Was ist Stable Diffusion?

Stable Diffusion 1 bzw. Stable Diffusion 2 ist eine von Stability AI entwickelte KI-Anwendung, die künstliche Intelligenz einsetzt, um aus einem geschriebenen Satz ein Bild zu generieren. Stable Diffusion 1 wurde im August 2022 von Stability AI veröffentlicht, der Nachfolger Stable Diffusion 2 erschien im Dezember 2022.

Welches Unternehmen steht hinter Stable Diffusion?

Stable Diffusion stammt aus dem Hause "Stability AI". Einem in London ansässigen Start-up, das 2020 gegründet wurde. Unter dem CEO Emad Mostaque konnte das Start-up innerhalb kürzester Zeit Millionen Dollar an Investments generieren. Zu den Investoren gehören: Coatue Management, Eros Investments und Lightspeed Venture Partners. Auch Mostaque selbst, ehemaliger Hedgefondsmanager, investierte finanziell in sein Start-up.

Laut Bloomberg soll Stablity AI mit 1 Milliarde US-Dollar bewertet worden sein und steigt damit in den Kreis der "Unicorns" auf.

Doch an dem Produkt Stable Diffusion haben mehrere Seiten mitgewirkt. Neben Stability AI waren auch RunwayML, EleutherAI, LAION und einer Forschungsgruppe der LMU München - unter der Leitung von Björn Ommer - beteiligt.

Stability AI Launch

Welche Technik steckt hinter Stable Diffusion?

Stable Diffusion ist eine Open-Source-Software, die es ihren Nutzer:innen ermöglicht, auf dem bestehenden Code aufzubauen und mit diesem zu arbeiten.

Die Anwendung fußt auf dem Deep Learning System. Deep Learning ist eine Unterkategorie des „Machine Learnings“, die sich mit der Entwicklung von neuronalen Netzen beschäftigt. Im Gegensatz zu herkömmlichen neuronalen Netzen, die nur eine oder wenige Schichten haben, bestehen tiefe neuronalen Netze aus mehreren Schichten (daher der auch der Name "Deep"). Dies ermöglicht es, komplexere Muster und Beziehungen in großen Datenmengen zu erkennen und zu erlernen. Deep Learning wird häufig in Anwendungen wie Computer Vision - der Bilderkennung - oder der Spracherkennung genutzt.

Wollen Sie mehr zu den unterschiedlichen KI-Typen und der Funktionsweise von Künstlicher Intelligenz wissen? Dann lesen Sie unseren Artikel "Künstliche Intelligenz (KI): Alles über ChatGPT-3, Dall-E, Machine Learning"

Doch wie kann die KI eine Verbindung zwischen Wort und Bild herstellen? Das Programm wurde vorab mit einer Vielzahl an Bildern trainiert. Jedes Bild wurde entsprechend mit dem passenden Begriff versehen und dann einem latenten Diffusionsmodellprozess unterzogen.

Was versteht man unter jener Diffusion? Ausgehend von einem Muster, das aus zufälligen Punkten bzw. Pixeln, besteht, entsteht allmählich ein Bild, sobald das Programm bestimmte Aspekte des Bildes erkennt.

Welche Daten verwendet Stable Diffusion?

Das System wurde mit einer Vielzahl an Bildern trainiert, die aus dem LAION Aesthetics-Datensatz stammen. Millionen von Bildern wurden für das Training von Stable Diffusion verwendet.

Da es sich bei Stable Diffusion um eine generative KI handelt, greift sie auf bestehende Quellen zurück, um daraus neue Zusammensetzungen zu produzieren bzw. "generieren".

Hinter LAION steckt ein gemeinnütziges Forschungsnetzwerk. Auf ihrer Website wird betont, dass der Datensatz weder kuratiert ist - es könnten unter anderem, wie LAION schreibt, "verstörende Bilder" auftauchen, noch für die "Erstellung fertiger Industrieprodukte" empfohlen wird.

Die Bilddateien werden von Pinterest, WordPress, Flickr etc. bezogen. Dabei wird auf die Links der jeweiligen Bilder referenziert; die Bilddatei an sich wird nicht bei LAION gespeichert.

Rechtsstreit - Wem gehören die Trainingsdaten?

In den USA haben Künstler:innen eine Klage gegen Stable Diffusion eingereicht, weil das AI-Tool die Rechte von Künstler:innen verletze. Konkret geht es um den Vorwurf der Urheberrechtsverletzung. So soll Stable Diffusion mit Milliarden von urheberrechtlich geschützten Bildern trainiert worden sein.

"Wenn Stable Diffusion und ähnliche Produkte weiterhin so arbeiten dürfen, wie sie es jetzt tun, ist das vorhersehbare Ergebnis, dass sie genau die Künstler ersetzen werden, deren gestohlene Werke diese KI-Produkte antreiben und mit denen sie im Wettbewerb stehen. KI-Bildprodukte verletzen nicht nur die Rechte von Künstlern, sondern werden, ob sie es nun wollen oder nicht, den Beruf des "Künstlers" ausschalten", heißt es in einem Statement der Kanzlei Joseph Saveri LLP.

Wie funktioniert Stable Diffusion?

Es gibt mehrere Varianten auf die Anwendung zuzugreifen.

Über die Website von Stability AI - hier ist das Tool unter "Dream Studio" zu finden.

Über den Hugging Face Hub - eine Plattform, auf der KI-Modelle, Datensätze und Demos zur Verfügung gestellt werden

Über einen Download auf das eigene Endgerät

Schritt-für-Schritt Anleitung Stable Diffusion

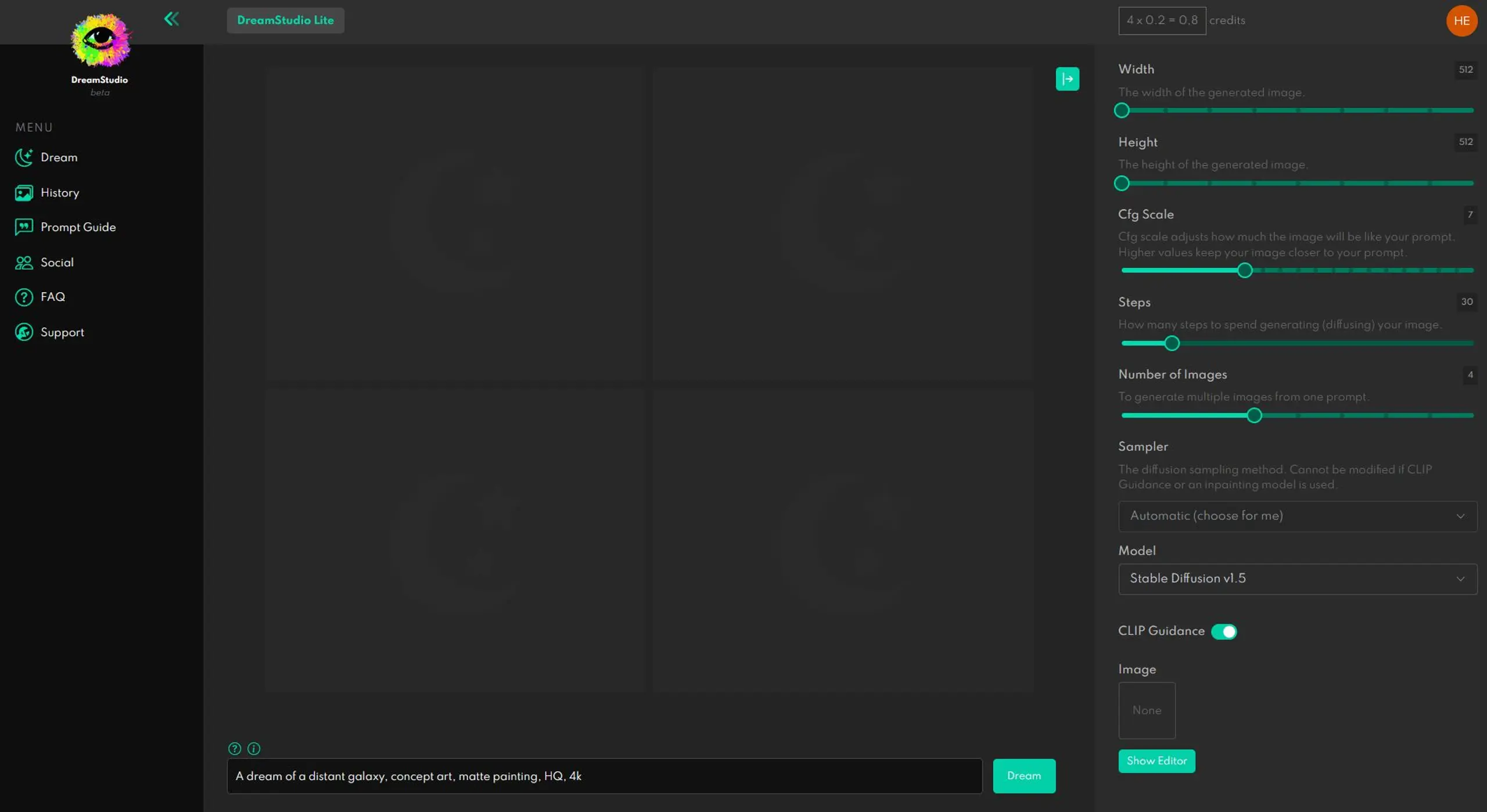

Die einfachste Variante ist jene über die Stability AI-Website. Dieser Use Case soll im folgenden Schritt-für-Schritt erläutert werden.

Öffnen Sie die Website von Stability AI

Scrollen Sie ganz nach unten bis Sie die "Dream Studio" Anwendung sehen und klicken Sie auf join here

Registrieren Sie sich mit Ihrer Email-Adresse

Sie erhalten daraufhin ein Bestätigungsmail. Über den Link in der Mail gelangen Sie auf die Front End Applikation des "Dream Studios"

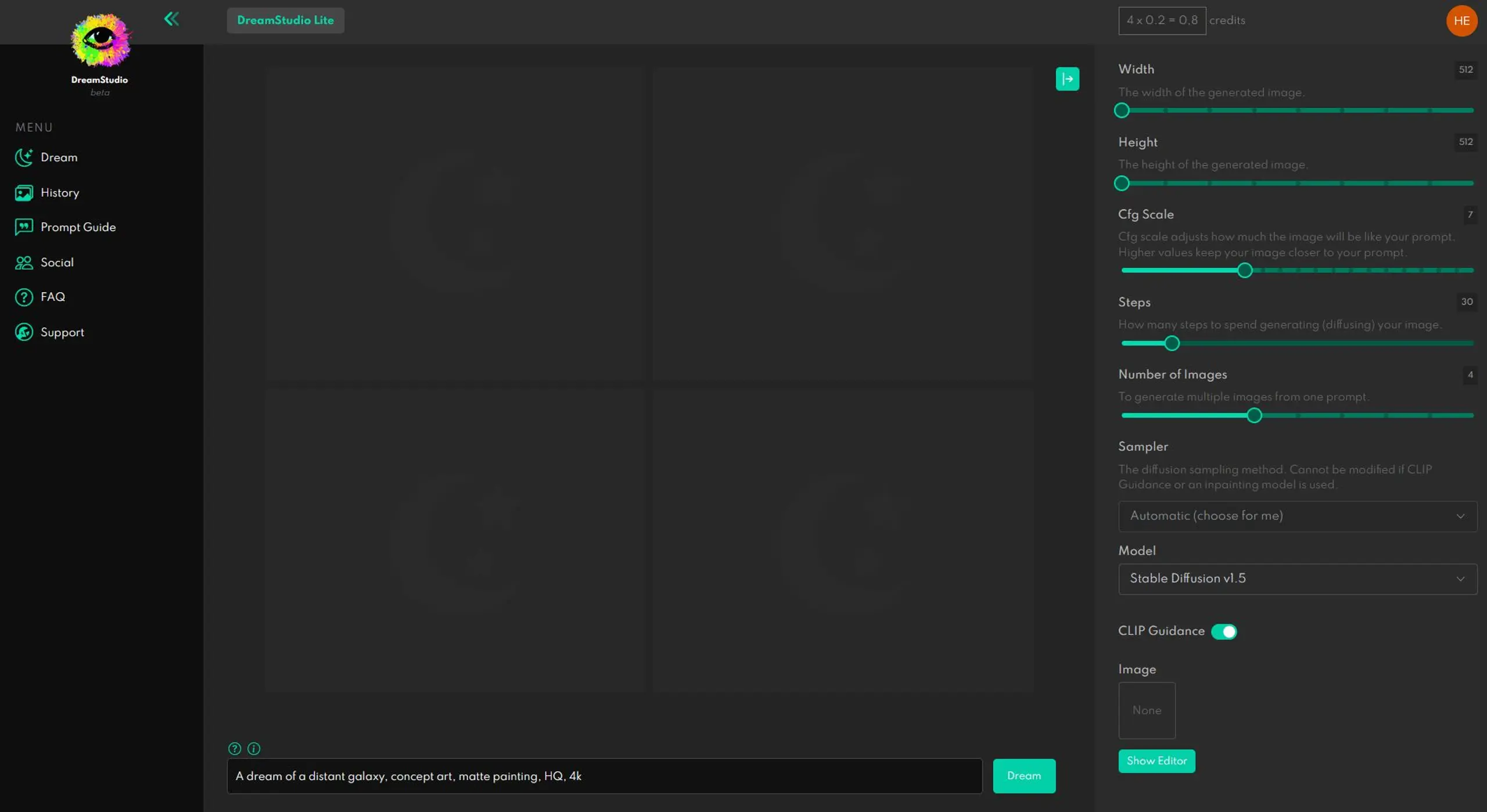

Stable Diffusion in der Dream Studio Anwendung

© Screenshot/Dream StudioNun geben Sie ihren Textbefehl (Prompt) in das unten ausgewiesene Textfeld ein.

Was ist ein Prompt?

Sehr einfach formuliert: Ein Prompt ist jene Information, die Sie einer KI geben, damit sie das tut, was Sie von ihr wollen.

Prompts sind Grundlage aller KI-Tools

Die Qualität eines Prompts definiert die Qualtiät des Resultats. Heißt: Je präziser der Prompt formuliert wird, desto hochwertiger und exakter ist der Output, den die KI liefert.

Prompt-Tipps für Stable Diffusion

Stable Diffusion hat einen eigenen Prompt-Guide veröffentlicht, mit dessen Hilfe bessere Ergebnisse erzielt werden sollen. Den Prompt-Guide finden Sie hier (Hierfür müssen Sie einen Account haben).

Zusammenfassend lässt sich sagen:

Beschreiben Sie das Motiv so detailliert wie möglich

Verwenden Sie Stichwörter, statt ausformulierter Schachtelsätze

Inkludieren Sie auch eine Beschreibung des Hintergrunds bzw. der Umgebung

Definieren Sie einen bestimmten Stil, den Sie dem Bild verleihen wollen. Beispielsweise: Ölgemälde, minimalistisch, Retro, 3D-Illustration etc.

Definieren Sie die Stimmung, die das Bild ausstrahlen soll

Inspiration für gute Prompts findet man zahlreiche im Web. Die Website prompthero.com umfasst zahlreiche Prompts, samt ihrer Ergebnisse, für unterschiedlichste KI-Anwendungen. Prompts für Stable Diffusion finden Sie hier.

Nach der Eingabe Ihres Prompts erhalten Sie vier Bildvarianten

Ein Bild basierend auf dem Prompt: portrait of retrofuturistic businesswoman, confident, elegant, mature, monochrome, concept art, max detail

© Stable Diffusion/trend.at

Ein Bild basierend auf dem Prompt: portrait of retrofuturistic businessman, confident, elegant, mature, monochrome, concept art, max detail

© Stable Diffusion/trend.atWie kann man die Künstliche Intelligenz genau bedienen? Mehr zum Thema "Prompt" lesen Sie hier

Was kostet Stable Diffusion?

Ist Stable Diffusion gratis? Prinzipiell ist die Anwendung kostenlos.

Alternativen zu Stable Diffusion

Weitere KI-Bildgeneratoren zum Ausprobieren:

Copyright - Wem gehört das Bild?

Diese Frage kann das Unternehmen Stability AI selbst nicht klar beantworten. Auf ihrer Website heißt es dazu: "Der Bereich der KI-generierten Bilder und des Urheberrechts ist komplex und variiert von Rechtsprechung zu Rechtsprechung."

Es empfiehlt sich jedoch, die AGB genau durchzulesen.

Wie auch bei anderen KI-Bildeditoren stehen sich hier zwei Positionen gegenüber. So gibt es die eine Seite, die den Standpunkt vertritt, dass das Urheberrecht am Output der KI dem Programmierer derselben zukommen sollte. Die andere Seite vertritt die Ansicht, dass der Inputgeber/Prompt-Engineer, also jemand der der KI einen Auftrag zum Generieren von Content gibt, zum Urheber wird.

Stable Diffusion: Vergleich zu DALL-E und Midjourney

Ein wesentlicher Pluspunkt, wenn man Stable Diffusion mit DALL-E oder Midjourney vergleicht - das Tool ist kostenlos. Zudem ist die Auflösung, zumindest im direkten Vergleich mit DALL-E, bei Stable Diffusion höher.

Auch die Geschwindigkeit und Umsetzung der Prompts verlief im Vergleich bei Stable Diffusion besser. Auch wenn die Unterschiede minimal sind.

Die Bildqualität ist bei allen drei KI-Apps gut; auch wenn DALL-E hier ein klein wenig die Nase vorn hat.

Es lässt sich sagen, dass Stable Diffusion, wie auch DALL-E und Midjourney beeindruckende KI-Bildgeneratoren sind. Und bedenkt man, dass es sich dabei um noch recht neue Anwendungen handelt; kann man zukünftig noch von einer Qualitätssteigerung ausgehen.

Fazit

Stable Diffusion ist einfach zu bedienen, gut zugänglich und de facto selbsterklärend. Das Tool ist in der Lage die verschiedensten Objekte, Konzepte und Stile zu kombinieren. Die Auflösung ist gut, die Qualität der Bilder überzeugt. Schwächen liegen in der fehlenden Kuration der Datensätze. Dadurch können auch anstößliche Bilder generiert werden. Zudem spielt auch hier - wie bei den meisten KI-Tools - der Algorithmic bias eine Rolle. Bilder werden in Sachen Hautfarbe, Nationalitäten etc. wenig vielfältig dargestellt.

Es mag auch vorkommen, dass spezifische Prompt-Informationen einfach ignoriert werden. In diesen Fällen ist es für die User nicht nachvollziehbar, warum die KI Teile des Befehls nicht ausgeführt hat.

Zu beachten: Prompts in englischer Sprache funktionieren besser; da die Trainingsdaten überwiegend englische Vokabeln beinhalten.